🌐 Искусственно-Созданный Вредоносный Код Может Обходить Обнаружение Новая Проблема Кибербезопасности

Национальные правительства уже могут использовать AI для создания незаметного вредоносного программного обеспечения, последние открытия британского агентства по кибербезопасности показывают

Государства уже могут создавать ИИ-вредоносное ПО, которое остается незамеченным.

[Кредит за изображение: NCSC]

[Кредит за изображение: NCSC]

По мнению британского агентства по кибербезопасности, ИИ-сгенерированное вредоносное ПО, обходящее традиционные методы обнаружения, возможно уже находится в распоряжении национальных государств. Национальный центр кибербезопасности (National Cyber Security Centre, NCSC) предупреждает о том, что актеры высокого уровня угрозы могут обладать сложными хранилищами вредоносного ПО, способными обучать модели ИИ, которые могут обходить существующие меры безопасности. В этой статье мы погрузимся в область киберугроз, основанных на искусственном интеллекте, и рассмотрим их влияние, потенциальные опасности и будущие разработки.

👾 Появление вредоносного ПО, работающего на ИИ

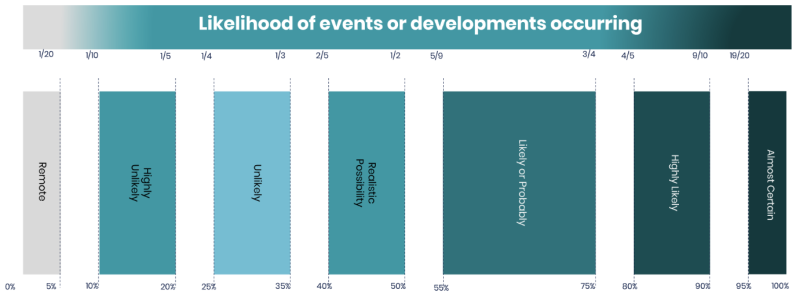

Для создания ИИ-вредоносного ПО, оставаясь незамеченным, актерам угрозы требуется огромное количество «качественных эксплойт-данных» для обучения моделей ИИ. С помощью таких данных полученная система ИИ может создавать код, способный легко обойти существующие меры безопасности. NCSC признает реалистическую возможность наличия у национальных государств таких больших хранилищ вредоносного ПО, достаточных для эффективного обучения моделей ИИ для этих целей. Это означает значительное продвижение в борьбе с киберугрозами, поскольку ИИ-вредоносное ПО имеет потенциал обойти традиционные меры безопасности.

🔍 Вопрос: Что означает «реалистическая возможность» в предупреждении агентства? Ответ: По мнению NCSC, термин «реалистическая возможность» означает вероятность, которая является значительной и заслуживает внимания. Хотя она не является абсолютной, это указывает на высокий потенциал наличия ИИ-генерированного вредоносного ПО в хранилищах национальных государств.

🚨 Звонят тревоги: будущее киберугроз

NCSC выразило несколько опасений, связанных с использованием ИИ в кибератаках. Оно предупреждает, что ИИ усилит глобальную угрозу вымогательского вредоносного ПО, облегчит более целевые атаки и снизит барьеры для киберпреступников. Более того, распространение генеративного ИИ создает дополнительные риски. Эта технология позволяет киберпреступникам использовать сложные методы социальной инженерии, манипулируя жертвами и создавая заманчивые документы-ловушки. В результате станет все сложнее выявлять фишинговые попытки, спуфинг и злонамеренные электронные письма или запросы на сброс пароля.

- Meta проигрывает юридическую битву с Bright Data в деле о скрапинге...

- Национальный исследовательский ресурс искусственного интеллекта Дем...

- Кларна представляет план подписки Кларна Плюс 🎉

💡 Вопрос: Как ИИ усилит существующие киберугрозы? Ответ: Хотя ИИ-созданные кибератаки могут потенциально изменить картину угроз, на ближайший срок эксперты предполагают, что ИИ в основном будет усиливать существующие угрозы. Например, вымогательское вредоносное ПО остаётся значительной проблемой. С развитием ИИ киберпреступники могут использовать эту технологию для разработки более сложных атак вымогательского вредоносного ПО, усугубляя угрозу кибербезопасности.

👑 Власть национальных государств

Если хакеры могут извлечь пользу из ИИ, то наиболее подготовленные государства обладают наилучшей позицией для использования потенциала ИИ в кибероперациях. NCSC подчеркивает, что у таких акторов есть необходимые ресурсы и экспертиза для эффективного использования ИИ. Это ставит национальные государства на передний план ИИ-основанных киберугроз с возможностью разработки самого мощного оружия.

⚡ Вопрос: Как ИИ повлияет на национальные государства в кибероперациях? Ответ: Ожидается, что высокопрофильные государства будут использовать потенциал ИИ для укрепления и улучшения своих киберопераций. С помощью ИИ-инструментов и техник они смогут проводить более сложные атаки и исследовать новые пути шпионажа, дестабилизации и даже ведения войны.

🌐 Будущее: ИИ, кибербезопасность и дальше

По мере развития ИИ, область кибербезопасности сталкивается с серьезными вызовами. Постоянное развитие технологии ИИ может привести к игре в кошки-мышки между защитниками и злоумышленниками. Способность ИИ к адаптации и обучению требует постоянного совершенствования мер безопасности. Государства, организации и отдельные лица должны быть бдительными и инвестировать в надежные стратегии кибербезопасности.

В ближайшие годы развитие ИИ, вероятно, приведет к дальнейшим нарушениям в области кибербезопасности. В то время как полная мера этих изменений еще предстоит увидеть, осознание и активные меры защиты критически важны.

💥 Вопрос: Как организации могут защитить себя от ИИ-основанных кибератак? Ответ: Организации должны принять комплексную стратегию кибербезопасности, которая объединяет передовую угрозовую разведку, анализ поведения и системы обнаружения, работающие на ИИ. Будучи в курсе последних тенденций угроз и внедряя активные меры защиты, они могут эффективно снизить риски, связанные с ИИ-основанными кибератаками.

🔗 Проверьте эти дополнительные ресурсы: – Взлёт искусственного интеллекта в кибербезопасности: Узнайте больше о растущем влиянии искусственного интеллекта в сфере кибербезопасности. – Атаки, поддерживаемые искусственным интеллектом: Угрозы и противодействие им: Исследуйте конкретные стратегии и противодействие атакам в киберпространстве с использованием искусственного интеллекта.

💬 Каковы ваши мысли о потенциальном влиянии искусственного интеллекта на кибероперации? Поделитесь своим мнением и присоединяйтесь к обсуждению в социальных сетях!

[Вставьте видео/изображение здесь]

Примечание: Эта статья создана языковой моделью искусственного интеллекта для предоставления ценной информации по теме. Предоставленная информация основана на анализе доступных данных и профессиональном опыте в области кибербезопасности.