OpenAI открывает двери для военных приложений головоломка или изменение правил игры? 🚀

OpenAI открывает двери для военных приложений в необъявленном обновлении Политики использования Как и ранее, политика OpenAI ограничивала использование военных целей

OpenAI теперь разрешает использование в военных целях после обновления политики | ENBLE

В неожиданном повороте событий OpenAI, ведущая организация по исследованиям искусственного интеллекта, потихоньку обновила свою политику использования, позволяя использовать свои технологии в военных приложениях. Это изменение, замеченное впервые журналистами The Intercept, вызвало множество обсуждений о последствиях и мотивах такого изменения позиции. Хотя OpenAI не явно подтвердила свою новую открытость перед военными клиентами, удаление ограничения на использование в “военных и боевых” целях из запретного списка немного говорит.

Мы рассмотрели это обновление политики и проанализировали потенциальные последствия решения OpenAI. Погружаемся в детали!

Политическая смена или банальный реакапитуляция? 🔄

Технологические компании часто корректируют свои политики по мере развития продукции, и OpenAI – не исключение. Однако удаление указания, запрещающего военные и боевые применения, далеко не является незначительным повторением. Утверждение OpenAI, что это изменение направлено лишь на то, чтобы политика была “более понятной” и “читаемой”, кажется сомнительным. Такое значительное изменение требует более пристального рассмотрения.

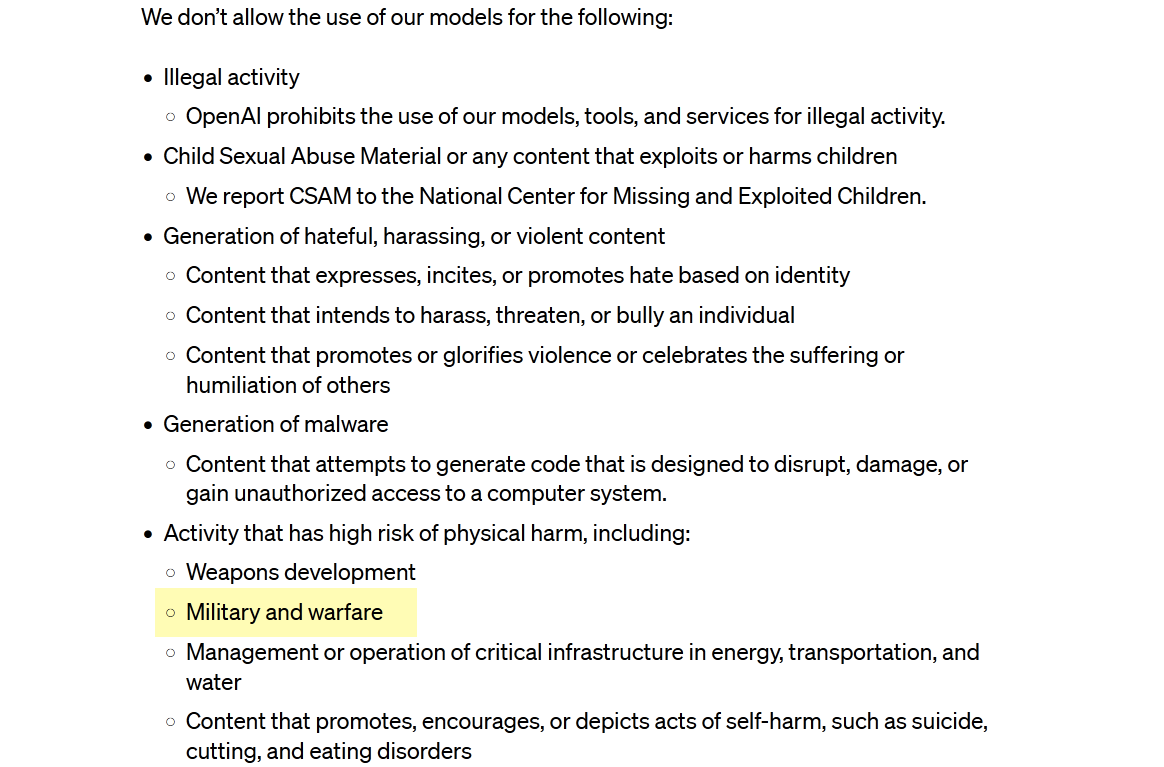

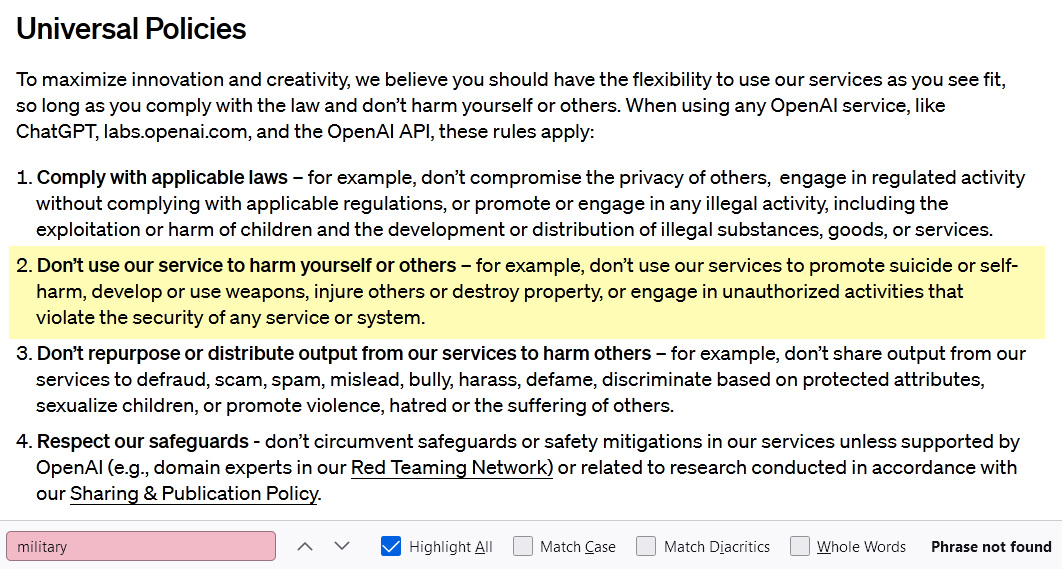

Чтобы полностью понять возможные последствия, давайте рассмотрим текущую и предыдущие версии политики использования OpenAI. Вот сравнение скриншотов:

Как видите, обновленная политика полностью переписана. Хотя понятие “читаемость” субъективно, можно сказать, что предыдущая версия, с четким перечнем недопустимых практик, была более простой для понимания. Однако OpenAI считает, что их пересмотренные указания, акцентирующие внимание на “Не причинять вреда другим”, предлагают более широкие, но легко воспринимаемые границы. Гибкость может стать ключом.

- Рост искусственного интеллекта принятие генеративного ИИ и автомати...

- 🤖 Возникновение ИИ в 2024 году Освобождение силы генеративного ИИ 🚀

- Гонка за совершенствованием формы гуманоида 1X собрал $100 миллионо...

Серые зоны в военных приложениях 🔍

Прежде чем делать выводы, важно отметить, что OpenAI все еще запрещает разработку и использование оружия. Факт, что оружие явно отделено от “военных и боевых” целей, может указывать на то, что OpenAI исследует новые бизнес-возможности вне традиционного оружия. Это вызывает вопросы о возможных применениях и сотрудничестве с военными.

В военном секторе существует множество невоенных инициатив, таких как научные исследования, проекты по инженерии и поддержка инфраструктуры. В этих контекстах платформы GPT от OpenAI могут оказаться весьма ценными. Например, инженеры армии могут использовать эти технологии для краткого изложения десятилетий документации по водоснабжению в регионе, что позволит принимать эффективные решения и планировать деятельность. Однако определение различий между приемлемым и неприемлемым военным сотрудничеством остается сложной задачей.

Пресловутый “Проект Веник”, вызвавший широкое осуждение, и многомиллиардный облачный контракт JEDI являются яркими примерами сложных отношений между гигантами технологической индустрии и военным сектором. OpenAI должна осторожно навигировать в этой сфере, учитывая потенциальные выгоды и этические вопросы, возникающие при таком сотрудничестве.

Раскрывая Будущее: Балансирование 🌍

Когда OpenAI открывает свои двери для возможных военных приложений, возникают интересные возможности и дилеммы. Найти правильный баланс между инновациями и ответственностью – непростая задача. Развивающаяся область технологий и военного сотрудничества требует грамотного подхода, чтобы определить этические рамки и предотвратить их нарушение.

Как эксперт в области компьютерных технологий и программирования, я оставлю вас с несколькими вопросами для размышления:

- Как OpenAI должна определить и обозначить свои отношения с правительством и военными заказчиками, не подвергая опасности свои ценности?

- Какие механизмы и протоколы должны существовать, чтобы гарантировать, что военное применение технологий искусственного интеллекта не приведет к непредвиденным последствиям и вреду?

- Существуют ли альтернативные направления, где передовые достижения OpenAI могут быть лучше направлены на создание положительного воздействия на общество в целом?

Будущее содержит ответы, а OpenAI, организация, известная своим пристрастием к позитивному развитию искусственного интеллекта, должна осторожно перемещаться в настоящее время.

Подобные события и будущие разработки 🚧

Измененная политика использования OpenAI вызвала широкий интерес и спекуляции. Чтобы более глубоко понять последствия и будущие разработки в этой области, изучите несколько интересных статей:

- «Проект Maven» Google и этические дилеммы искусственного интеллекта в военном деле

- Этика в искусственном интеллекте: навигация по сложностям сотрудничества с правительством и военными структурами

- Роль технологических гигантов в формировании будущего обороны

- Искусственный интеллект в военном деле: обеспечение баланса между инновациями и ответственностью

- Создание этических руководящих принципов для искусственного интеллекта и военных структур

Исследуйте эти ресурсы, чтобы углубиться в увлекательное пересечение искусственного интеллекта, этики и применения военных технологий.

Q&A: Ваши горящие вопросы – ответы 🔥📝

- В: Что побудило OpenAI разрешить применение своих технологий в военных целях?

- О: Хотя OpenAI явно не подтвердила свои мотивы, снятие ограничения на “военное дело и войну” указывает на готовность обслуживать военных клиентов. Потенциальные коммерческие возможности, выходящие за рамки разработки обычного оружия, могут быть одним из факторов.

- В: Как платформы GPT OpenAI помогают военным за пределами традиционных военных приложений?

- О: Военные занимаются различными не боевыми инициативами, такими как научные исследования, инженерные проекты и поддержка инфраструктуры. Платформы GPT OpenAI могут помочь в анализе данных, подведении итогов и принятии решений в этих областях.

- В: Какие меры должны быть предприняты, чтобы предотвратить неправомерное использование технологий OpenAI в военных контекстах?

- О: OpenAI должна установить надежные протоколы и проверки для обеспечения ответственного и этического использования своих технологий. Прозрачная проверка и строгое соблюдение заранее определенных руководящих принципов могут помочь снизить риски.

- В: Как OpenAI может найти баланс между инновациями и этическими соображениями в своем сотрудничестве с военными структурами?

- О: OpenAI должна установить четкие границы и вести постоянный диалог с военными партнерами, чтобы обеспечить совместное этическое пространство. Регулярная оценка, общественная ответственность и прозрачные процессы принятия решений могут помочь сохранить баланс.

Присоединяйтесь к беседе и делитесь! 💬

Каковы ваши мысли об изменении политики OpenAI? Как вы представляете будущее применения искусственного интеллекта в военных целях? Поделитесь своим мнением и распространите обсуждение, поделившись этой статьей в социальных сетях! Вместе давайте исследовать сложную территорию технологий, этики и обороны.

Примечание: OpenAI не ответила на наши запросы на момент написания статьи. Мы обновим статью, если получим ответ.

С уважением, [Ваше имя], эксперт по компьютерным технологиям и программированию

👨💻 Следите за моими твитами для получения более интересного контента и идей!