«🖼️Изображения, сгенерированные с помощью DALL-E 3 и OpenAI API, теперь имеют водяные знаки!🖼️»

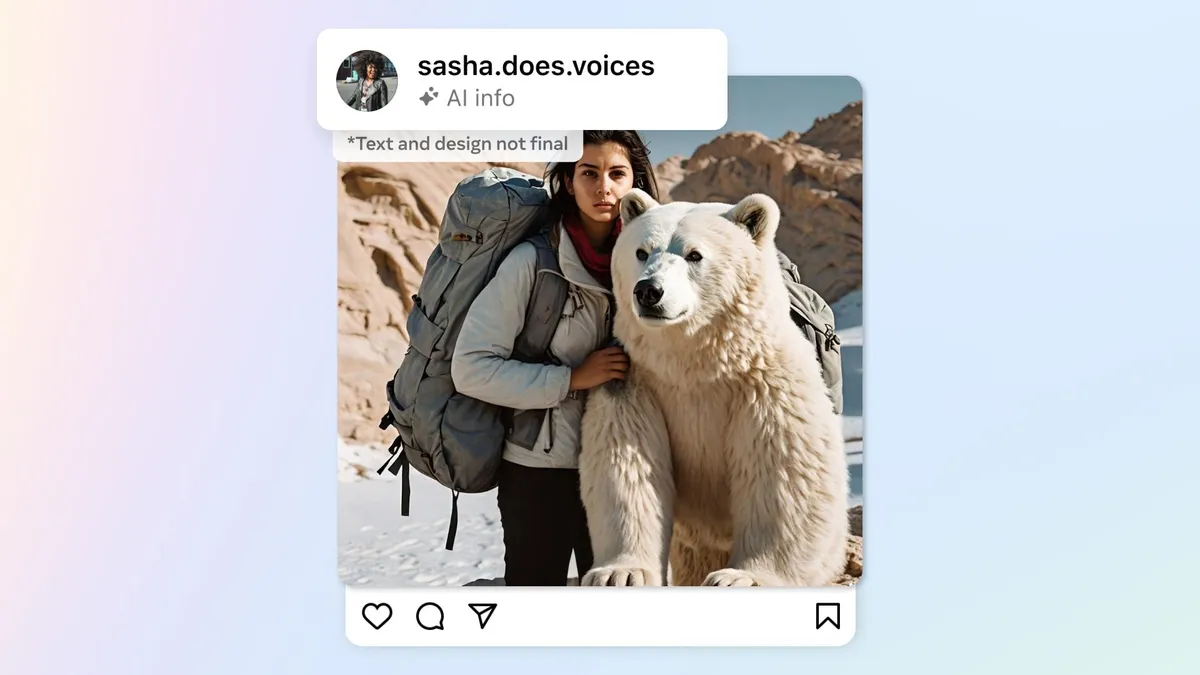

OpenAI теперь будет добавлять водяные знаки на изображения, созданные ChatGPT с использованием DALL-E 3.

💦 Устали от плавания в море дипфейков и дезинформации? OpenAI вас поддерживает! В недавнем объявлении компания сообщила, что изображения, созданные с помощью их мощных инструментов искусственного интеллекта DALL-E 3 и OpenAI API, теперь будут снабжены новыми блестящими водяными знаками. Давайте нырнем и посмотрим, что это значит для мира медиа, созданного искусственным интеллектом. 💦

📸 Подтверждение подлинности с помощью метаданных C2PA

OpenAI проявляет свои технологические мускулы, интегрируя метаданные в изображения, созданные ChatGPT и OpenAI API. Эти метаданные, созданные в соответствии со спецификациями Соглашения о происхождении и подлинности контента (C2PA), позволяют пользователям проверять источник и историю контента. 🧐

Стандарт C2PA, поддерживаемый такими крупными компаниями, как Adobe, Microsoft и BBC, нацелен на борьбу со всплеском дипфейков и дезинформации. Сертифицируя подлинность медиа, он служит щитом против цифрового обмана. OpenAI, принявший этот стандарт, теперь позволяет пользователям быть уверенными в том, что изображения, с которыми они сталкиваются, можно проследить до их искусственного интеллекта. 🕵️♂️

🧩 Головоломка метаданных

Но что же это за волшебные метаданные? В них содержится информация о используемом инструменте искусственного интеллекта и дате создания изображения. 🗓️ Вы даже можете проанализировать метаданные, загрузив изображение на сайты для проверки, такие как Content Credentials. Это похоже на CSI: Кибер-версию! 🔍

И не волнуйтесь, дорогие читатели! OpenAI заверяет нас, что эти дополнительные метаданные не повлияют на качество изображения, несмотря на небольшое увеличение размера файла. Так что вы можете получить качественные изображения, созданные искусственным интеллектом, с дополнительным бонусом сертификации. 🍰

- Генератор изображений DALL-E 3 от OpenAI добавляет водяные знаки дл...

- 📸 Захватывайте и открывайте мир с помощью функции вопрос-ответ изоб...

- Обязательства Lenovo по устранению предвзятости искусственного инте...

👻 Остерегайтесь дипфейков!

Инструменты генерации изображений на основе искусственного интеллекта стали доступными как никогда. С помощью таких инструментов, как DALL-E 3, Midjourney, Bard и Copilot, любой может создать свои собственные дипфейки или распространять ложную информацию быстрее, чем гепард на роликовых коньках. Это как дать малышу огнемет. 🔥

Недавно скандальные дипфейки Тейлор Свифт разгорелись в интернете, подчеркивая неотложную необходимость проверки изображений и надежных мер защиты, особенно для публичных персон. Фактически, Президент Байден выдал указ в октябре 2023 года об обязательной пометке контента, созданного с помощью искусственного интеллекта. Министерство торговли получило задание предоставить руководство по добавлению водяных знаков, а также требовать от создателей инструментов искусственного интеллекта информировать американское правительство об их разработках. 📜

❓ Вопросы и ответы: Вглядываясь в бездну изображений, созданных искусственным интеллектом ❓

В: Разве метаданные не могут быть легко удалены, что делает водяные знаки бесполезными? Ответ: Вы совершенно правы! Социальные сети часто удаляют метаданные из загруженных изображений, и даже обычный скриншот может их стереть. Так что, хотя водяные знаки являются шагом в правильном направлении, они не являются непроницаемым щитом. Борьба с дипфейками продолжается, дорогой друг.

В: Что насчет других форм контента, созданного искусственным интеллектом, таких как голос или текст? Они тоже получают водяные знаки? Ответ: Отличный вопрос! Вечеринка с водяными знаками ограничена изображениями, созданными ChatGPT и OpenAI API. Так что, к сожалению, голос и текст пока не будут украшены модными водяными знаками. Оставим это изображениям для показа!

🌐 Будущее проверки изображений, созданных искусственным интеллектом

Шаг OpenAI по добавлению водяных знаков на изображения, созданные искусственным интеллектом, является многообещающим шагом в борьбе с цифровым обманом. Однако важно продолжать преодолевать границы технологии. Улучшение методов обнаружения дипфейков, разработка надежных систем отслеживания метаданных и повышение подлинности контента в целом будут ключевыми в борьбе за более надежный цифровой ландшафт. 🛡️

🔗 Ссылки: 1. Твит OpenAI о внедрении водяных знаков 2. Сайт Соглашения о происхождении и подлинности контента (C2PA) 3. Bard создает изображение Тейлор Свифт, несмотря на то, что Google намекал на то, что это не произойдет 4. Исследование Wall Street Journal подчеркивает подростковую экспозицию к конфликтному контенту на TikTok 5. Директор по искусственному интеллекту превращается в защитника художников 6. Google запускает SynthID, невидимый водяной знак для изображений, созданных искусственным интеллектом 7. Новый закон Сената, направленный на защиту жертв несогласованных дипфейков, созданных искусственным интеллектом 8. OpenAI выпускает исправление утечки данных ChatGPT 9. OpenAI сокращает регуляторный риск с помощью защиты данных ЕС

Давайте вместе сделаем цифровой мир более безопасным местом! 🌐 Поделитесь этой статьей и распространите слово о важности проверки изображений с помощью искусственного интеллекта. 💙✨