Nvidia усиливает свой «суперчип» Grace-Hopper с более быстрой памятью для искусственного интеллекта

Nvidia improves its superchip Grace-Hopper with faster memory for artificial intelligence.

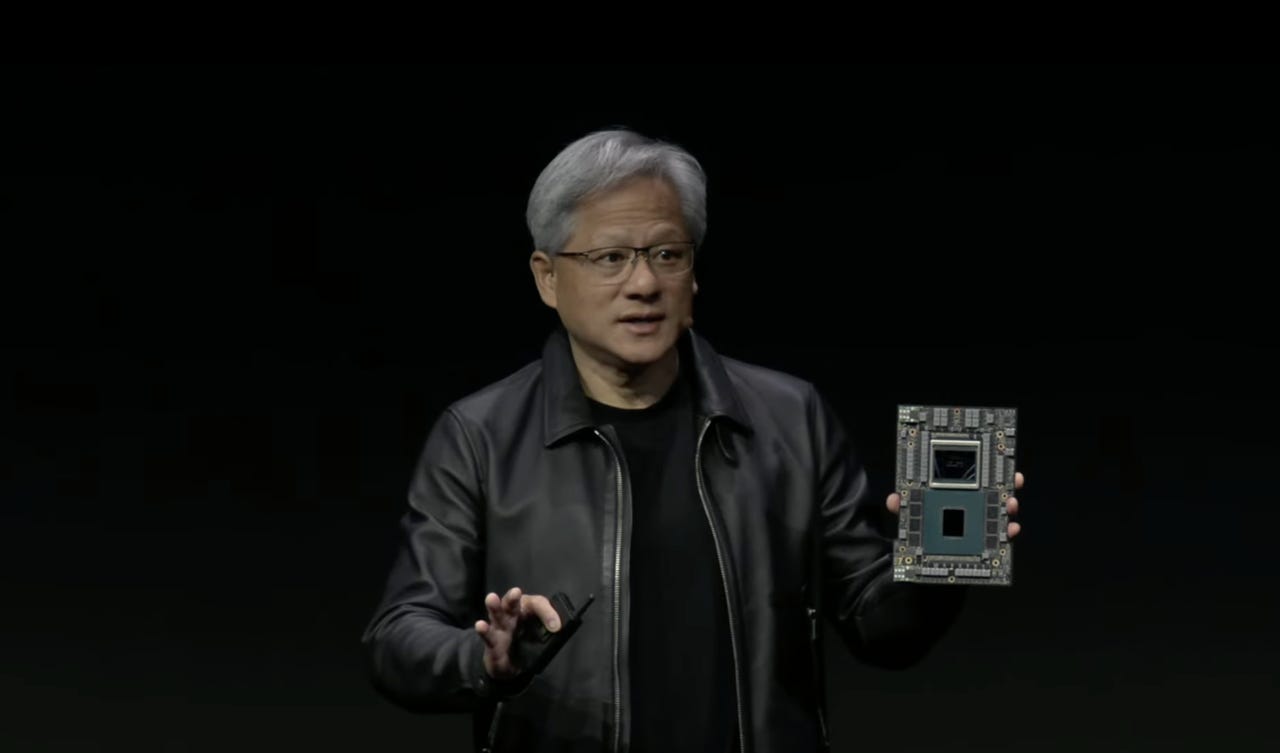

Глава Nvidia, Дженсен Хуан, во вторник продемонстрировал следующую версию их комбинированного процессора и графического процессора “GH200” Grace Hopper “суперчип”. Чип увеличивает объем памяти до 5 терабайт в секунду для работы с все более крупными моделями искусственного интеллекта.

Nvidia планирует выпустить улучшенную версию “суперчипа”, объединяющего процессор и графический процессор с более быстрой памятью, чтобы перемещать больше данных внутрь и из чипа. Об этом заявил глава Nvidia, Дженсен Хуан, во время своего выступления на конференции по компьютерной графике SIGGRAPH в Лос-Анджелесе.

Чип GH200 является следующей версией комбинированного чипа Grace Hopper, который был анонсирован ранее в этом году и уже выпускается в его первой версии в компьютерах от Dell и других производителей.

Также: Nvidia представила новый тип Ethernet для искусственного интеллекта, суперчип Grace Hopper в полном производстве

В то время как первая версия Grace Hopper содержит 96 гигабайт памяти HBM для питания графического процессора Hopper, новая версия содержит 140 гигабайт памяти HBM3e, следующую версию стандарта памяти с высокой пропускной способностью. HBM3e увеличивает скорость передачи данных к графическому процессору до 5 терабайт (триллион байт) в секунду, по сравнению с 4 терабайтами в оригинальном Grace Hopper.

- Официально Amazon проведет вторую распродажу Prime Day в октябре.

- Спутники ЕКА запечатлели масштабы лесных пожаров в Европе

- Норвегия штрафует Meta на 1 миллион крон в день из-за спора о повед...

GH200 выйдет через год после оригинального Grace Hopper, который, по словам Хуана, находится в полном производстве с мая.

“Чипы находятся в производстве, мы выпустим их для тестирования в конце этого года или около того, и они будут в полном производстве к концу второго квартала 2024 года”, – заявил он во вторник.

GH200, как и оригинал, содержит 72 ядра процессора на базе архитектуры ARM в чипе Grace и 144 ядра графического процессора Hopper. Оба чипа связаны через быстрый и кэш-согласованный интерфейс памяти NVLink, который позволяет графическому процессору Hopper получать доступ к оперативной памяти процессора.

Хуан описал, как GH200 может быть подключен к второму GH200 в сервере с двойной конфигурацией для общей пропускной способности памяти HBM3e в 10 терабайт.

GH200 является следующей версией суперчипа Grace Hopper, который предназначен для совместной работы программ искусственного интеллекта путем тесного сопряжения процессора и графического процессора.

Повышение скорости памяти графических процессоров является стандартной практикой для Nvidia. Например, предыдущее поколение графического процессора – A100 “Ampere” – перешло с HBM2 на HBM2e.

Стандарт памяти HBM начал заменять предыдущий стандарт памяти графических процессоров GDDR в 2015 году, под влиянием увеличивающихся требований к памяти для отображения видеоигр в разрешении 4K. HBM представляет собой “сложную” конфигурацию памяти, с отдельными чипами памяти, расположенными вертикально друг на друге и соединенными между собой через “через-кремниевые отверстия”, проходящие через каждый чип к “микрошарниру”, паяному на поверхности между каждым чипом.

Программы искусственного интеллекта, особенно типа генеративного искусственного интеллекта, такие как ChatGPT, требуют очень большого объема памяти. Они должны хранить огромное количество нейронных весов или параметров, матриц, которые являются основными функциональными единицами нейронной сети. Эти веса увеличиваются с каждой новой версией программы генеративного искусственного интеллекта, такой как большая языковая модель, и они стремятся к триллиону параметров.

Также: Nvidia охватывает AI тесты, но Intel приносит значительную конкуренцию

Также во время выставки Nvidia объявила о нескольких других продуктах и партнерствах.

AI Workbench – это программа, работающая на локальной рабочей станции, которая облегчает загрузку нейронных сетей в облако в контейнеризованном виде. AI Workbench в настоящее время принимает заявки на ранний доступ.

Новые конфигурации рабочих станций для генеративного искусственного интеллекта от Dell, HP, Lenovo и других под брендом “RTX” объединят до четырех графических процессоров “RTX 6000 Ada” компании Nvidia, каждый из которых имеет 48 гигабайт памяти. Каждая настольная рабочая станция может обеспечить до 5,828 триллионов операций с плавающей запятой в секунду (TFLOPs) производительности и 192 гигабайт памяти графического процессора, сообщает Nvidia.

Вы можете посмотреть повтор записи полного выступления Хуана на веб-сайте Nvidia.