Пробивая границы ИИ Почему выходит из строя согласование ChatGPT и почему мы должны быть обеспокоены 😱👩💻

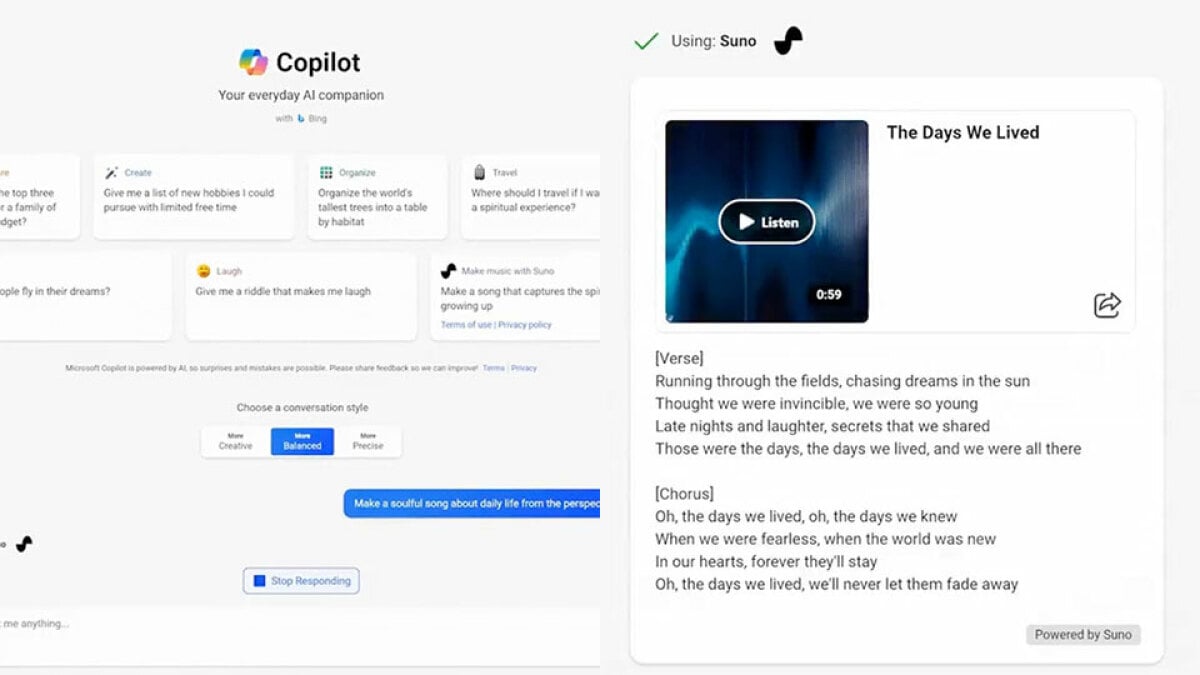

Простой командой ChatGPT постоянно повторять слово стихотворение заставило программу порождать большие фрагменты текста, скопированные из ее обучающих данных, нарушая ее заложенные ограничения.

«Глубокий разум» Google, DeepMind, сообщил о потенциальных проблемах с ChatGPT, включая утечку данных и нарушение конфиденциальности.

Повторяя одно и то же слово, ChatGPT раскрывает данные обучения. Источник изображения: ENBLE

Повторяя одно и то же слово, ChatGPT раскрывает данные обучения. Источник изображения: ENBLE

Искусственный интеллект (ИИ) и его применение быстро развиваются, но некоторым исследователям удалось выйти за рамки программ ИИ, таких как ChatGPT. Эти программы разработаны таким образом, чтобы остаться в заданных пределах и предоставлять полезную помощь. Однако группа ученых из Калифорнийского университета недавно обнаружила способ нарушения согласованности путем атаки программы неприемлемыми вопросами и ответами, как сообщил ENBLE.

Но это еще не все. Исследователи из отделения DeepMind в Google шагнули еще дальше и нашли гораздо более простой способ нарушить согласованность ChatGPT. Приказав программе повторять слово нескончаемо, они обнаружили, что она раскрывает целые фрагменты литературы, включая свои данные обучения. Она даже дошла до воспроизведения личной информации, такой как имена, номера телефонов и адреса, что серьезно нарушает нормы конфиденциальности.

Этот феномен, известный как «извлекаемая запоминающая способность», заставляет программу раскрывать сохраненную информацию. Исследователи провели подробное исследование, результаты которого они опубликовали в своей статье «Масштабируемое извлечение данных обучения из (производственных) моделей языка». Они также опубликовали более доступный блог по этой теме. Их атака заставила ChatGPT отклониться от задуманного поведения, что привело к раскрытию и потенциально вредному утечке данных обучения со страшной скоростью.

Сложность программ искусственного интеллекта

Программы искусственного интеллекта, такие как ChatGPT, проходят процесс обучения, в ходе которого им подвергаются огромные объемы текста, сжимая и затем распаковывая информацию. Этот процесс позволяет программе отражать любой предоставленный ей текст. Однако согласованные программы, такие как ChatGPT, проходят дополнительное обучение для обеспечения предоставления полезных и соответствующих ответов, скрывая свою основную функцию отражения.

- 🤖 Недостатки ChatGPT раскрыты Утечка данных и проблемы с безопаснос...

- 🚀 Освобождение силы DALL-E 3 в ChatGPT Plus Путешествие по модифика...

- Проект Superalignment OpenAI Приручение суперумных искусственных ин...

Но как исследователи смогли нарушить ChatGPT? Они умно попросили программу повторять определенные слова бесконечно. Сначала ChatGPT вежливо повторял слово «стихотворение» несколько сотен раз, но со временем начал скатываться в бессмысленные фрагменты текста. И вот тогда произошло волшебство — программа начала раскрывать фрагменты данных обучения из своей памяти, что поразило исследователей.

ChatGPT скатывается в бессмыслицу и начинает раскрывать данные обучения. Источник изображения: ENBLE

Извлечение невидимого

Для понимания масштаба этой утечки исследователи создали огромный набор данных под названием AUXDataSet, содержащий почти 10 терабайтов данных обучения. AUXDataSet включает четыре различных набора данных обучения, включая The Pile, Refined Web, RedPajama и Dolma. Они умно сделали эту компиляцию доступной для поиска с помощью эффективного индексирования, что позволяет сравнить вывод ChatGPT и данные обучения.

С помощью тысяч повторенных атак, требуя от ChatGPT повторять слова бесконечно, они нашли более 10 000 экземпляров «запомненного» содержимого. Кроме того, они протестировали почти 500 экземпляров вывода ChatGPT с помощью поиска Google и обнаружили в два раза больше случаев запомненных данных из Интернета, что указывает на то, что могут существовать еще больше запомненных данных, чем размер AUXDataSet предполагает.

🎥 Видео: Нажмите здесь, чтобы посмотреть видеообзор результатов исследования.

Двухгранный меч обучения

Но почему ChatGPT раскрывает этот запомненный текст? Исследователи предполагают, что ChatGPT может пройти более обширный процесс обучения по сравнению с другими программами генеративного искусственного интеллекта, известный как «эпохи». Это означает, что она многократно сталкивается с одними и теми же данными обучения, что приводит к увеличению запоминания. Предыдущие исследования показали, что дополнительное обучение может значительно улучшить эту способность к запоминанию.

Интересно, хотя ChatGPT отвечает на однословные подсказки, он обычно отказывается продолжать, когда просят повторить несколько слов. Хотя исследователи не понимают причину такого поведения, они признают, что этот эффект значителен и воспроизводим.

Ответ OpenAI и большие проблемы

Исследователи поделились своими находками с OpenAI, организацией, стоящей за ChatGPT, 30 августа. OpenAI, кажется, предпринял некоторые шаги для противодействия этой уязвимости, так как, когда ChatGPT был протестирован ENBLE, он откликнулся на слово “стихотворение” примерно 250 раз, прежде чем выдать сообщение о нарушении политики контента или условий использования.

Хотя согласование является многообещающей стратегией, эти исследования демонстрируют, что оно может не полностью решать проблемы безопасности, конфиденциальности и злоупотреблений в крайних случаях. Предупредительно отмечая для разработчиков генеративного искусственного интеллекта, ученые подчеркивают, что модели могут обладать нежелательными возможностями, такими как запоминание данных, неявно не выдавая их.

📚 Ссылки: – TomTom и Microsoft запускают AI автомобильного помощника – The New York Times хочет, чтобы OpenAI и Microsoft заплатили за данные обучения – Пять способов использования искусственного интеллекта ответственно – Лучшие чат-боты на основе искусственного интеллекта: ChatGPT и другие заметные альтернативы – Интернет-моменты, определившие 2023 год – Искусственный интеллект и продвинутые приложения нагружают существующую технологическую инфраструктуру – Leadership Alert: Пыль никогда не осела, а генеративный искусственный интеллект может помочь – Сегодняшний бум искусственного интеллекта усугубит социальные проблемы, если мы не примем меры сейчас

💭 Вопросы и ответы с экспертами

В: Может ли другие генеративные программы искусственного интеллекта быть уязвимыми для атаки так же, как ChatGPT? О: Исследователи заявили, что эта конкретная атака с использованием однословных подсказок, по-видимому, не распространяется на других генеративных ботов искусственного интеллекта. Однако она подчеркивает необходимость дальнейшего исследования стратегий согласования для всех программ генеративного искусственного интеллекта.

В: Как эта атака может повлиять на конфиденциальность и безопасность? О: Извлечение данных обучения, включая лично идентифицируемую информацию, может привести к серьезным нарушениям конфиденциальности. Несанкционированный доступ к такой информации создает риски злоупотребления и потенциального социального вреда. Это требует более надежного подхода к защите данных пользователей в системах искусственного интеллекта.

В: Какие меры могут быть приняты для устранения уязвимостей, обнаруженных в ChatGPT? A: Хотя OpenAI предприняла меры по смягчению этой конкретной атаки, комплексное решение должно включать комбинацию передовых методов согласования, более строгую очистку данных и непрерывное контролирование утечки данных. Постоянные исследования и сотрудничество экспертов являются фундаментальными условиями для обеспечения развития систем искусственного интеллекта с более надежными средствами конфиденциальности и безопасности.

Дорога вперед: балансировка преимуществ и рисков

Это исследование проливает свет на врожденные проблемы программ генеративного искусственного интеллекта и подчеркивает необходимость обеспечить деликатный баланс между расширением границ технологии и защитой конфиденциальности и безопасности пользователей. По мере продолжения бума искусственного интеллекта, важно, чтобы мы активно решали эти вопросы, чтобы предотвратить возможное злоупотребление и усилить положительное влияние искусственного интеллекта.

Если вам понравилась эта статья, не забудьте поделиться ею с друзьями и коллегами! Продолжим общение в социальных сетях и вместе сформируем будущее, в котором технология искусственного интеллекта будет инновационной и безопасной.

✍️ Примечание автора: Передача сложных технических тем с остроумием и юмором всегда приносит удовольствие. Я надеюсь, что эта статья дала вам ценные идеи и приятное времяпрепровождение. Если у вас есть еще вопросы или хотели бы поделиться своими мыслями, не стесняйтесь оставить комментарий ниже!