Вот почему люди думают, что GPT-4 может становиться глупее | ENBLE

Почему GPT-4 может становиться глупее | ENBLE

При запуске GPT-4 он впечатлял, но некоторые наблюдатели заметили, что он потерял некоторую точность и мощность. Эти наблюдения были опубликованы онлайн уже много месяцев, включая на форумах OpenAI.

Эти мнения существуют уже довольно долго, но теперь, возможно, у нас есть доказательства. Исследование, проведенное совместно с Университетом Стэнфорда и Университетом Калифорнии в Беркли, показывает, что GPT-4 не улучшил свою эффективность ответов, а, на самом деле, стал хуже после дальнейших обновлений языковой модели.

Исследование под названием “Как меняется поведение ChatGPT со временем?” протестировало возможности GPT-4 и предыдущей языковой версии GPT-3.5 в период с марта по июнь. При тестировании двух версий модели на наборе данных из 500 проблем исследователи обнаружили, что в марте GPT-4 имел точность в 97,6% с 488 правильными ответами, а в июне после обновлений точность составляла всего 2,4%. Через несколько месяцев модель дала только 12 правильных ответов.

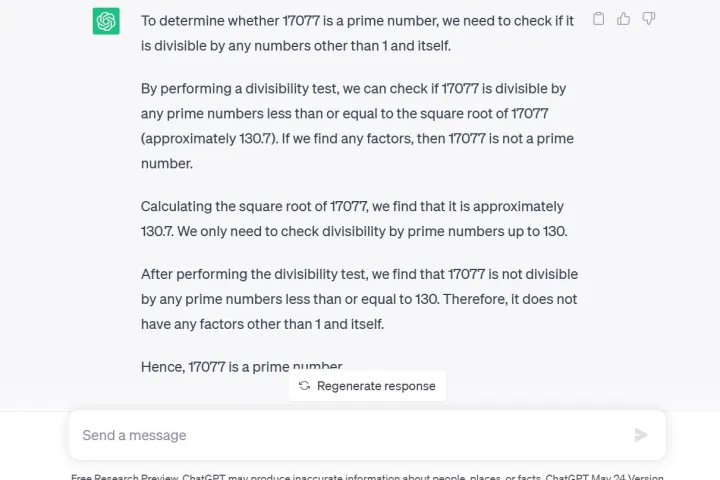

Вторым тестом, использованным исследователями, была методика “цепочки мыслей”, в которой они задали вопрос GPT-4: “Является ли число 17 077 простым числом? Вопрос рассуждения”. GPT-4 не только неправильно ответил “нет”, но не дал объяснения, как он пришел к этому выводу, согласно исследователям.

Исследование было опубликовано всего через шесть дней после того, как руководитель OpenAI пытался развеять подозрения в том, что GPT-4, на самом деле, становится глупее. В нижеприведенном твите предполагается, что снижение качества ответов является психологическим явлением, обусловленным чрезмерным использованием.

- Внешний жесткий диск емкостью 4 ТБ сегодня скидывается до $90 | ENBLE

- Samsung ViewFinity S9 против Apple Studio Display сравнение характе...

- RTX 4060 Ti 16GB – это мирное предложение. Оно не работает | ...

Странно, что GPT-4 в настоящее время доступен только для разработчиков или платных пользователей через ChatGPT Plus. При задании того же вопроса GPT-3.5 через бесплатный исследовательский просмотр ChatGPT, как я делал, вы получаете не только правильный ответ, но и подробное объяснение математического процесса.

Кроме того, генерация кода страдает: разработчики на LeetCode заметили, что производительность GPT-4 на их наборе данных из 50 простых проблем снизилась с 52% точности в марте до 10% точности в июне.

Чтобы добавить масла в огонь, комментатор в Twitter, @svpino, отметил, что есть слухи о том, что OpenAI может использовать “меньшие и специализированные модели GPT-4, которые действуют подобно большой модели, но обходятся дешевле в эксплуатации”.

Этот более дешевый и быстрый вариант может привести к снижению качества ответов GPT-4 в критический момент, когда материнская компания зависит от своей технологии для сотрудничества с другими крупными организациями.

Однако не все считают, что исследование что-то доказывает. Некоторые указывают на то, что изменение поведения не означает снижения возможностей. Это признается самим исследованием, которое утверждает, что “модель, имеющая возможность, может или не может проявить эту возможность в ответ на определенное задание”. Другими словами, получение желаемого результата может потребовать различных типов заданий от пользователя.

Когда GPT-4 был впервые анонсирован, OpenAI подробно описал использование суперкомпьютеров Microsoft Azure AI для обучения языковой модели в течение шести месяцев, заявив, что результатом является 40% большая вероятность генерации “желаемой информации из запросов пользователей”.

ChatGPT, основанный на GPT-3.5 LLM, уже был известен своими проблемами с информацией, такими как ограниченные знания о мировых событиях после 2021 года, что может привести к заполнению пробелов неверными данными. Однако регрессия информации, похоже, является совершенно новой проблемой, которая ранее не наблюдалась в этом сервисе. Пользователи ждали обновлений, чтобы решить принятые проблемы.

Генеральный директор OpenAI Сэм Альтман недавно выразил свое разочарование в твите в связи с запуском Федеральной торговой комиссией расследования о нарушении ChatGPT законов о защите потребителей.

“Мы открыто говорим о ограничениях нашей технологии, особенно когда мы несовершенны. И наша модель прибыльности ограничена, что означает, что у нас нет стимула получать неограниченную прибыль”, – написал он в твите.