Генеративное искусственное интеллекта значительно превзойдет то, что может сделать ChatGPT. Вот все о том, как технология развивается.

Генеративное искусственное интеллекта превосходит ChatGPT. Технология развивается.

Более чем любые другие вехи достижений искусственного интеллекта – победа в шахматы, предсказание складывания белка, маркировка котов и собак – форма ИИ, известная как генеративный ИИ, завораживает мировое воображение.

ChatGPT стал самой быстрорастущей программой в истории в январе, достигнув ста миллионов пользователей менее чем за два месяца после своего публичного дебюта. Он породил множество конкурентов, как проприетарные программы, такие как Bard от Google, и альтернативы с открытым исходным кодом, такие как Koala от университета Калифорнии в Беркли. Волнение вызвало гонку вооружений между гигантами технологической индустрии Microsoft и Google и их коллегами, а также взрыв в бизнесе производителя ИИ-чипов Nvidia.

Возбуждение от больших языковых моделей привело к расцвету многочисленных проприетарных и программ с открытым исходным кодом, увеличивающихся по масштабу только для текста. Диаграмма взята из статьи 2023 года “Эмоциональный интеллект больших языковых моделей” от Сюэны Ван и коллег из Университета Цинхуа.

Все это пылкое волнение имеет свои корни в том, что, в отличие от прошлых программ ИИ, которые в основном производили числовой результат – “1” для фотографии кошки, “0” для фотографии собаки – ChatGPT и программы для изображений, такие как Stable Diffusion от Stability.ai и DALL-E от OpenAI, воспроизводят что-то из мира.

Особенность

- Gmail получает реакции emoji. Вот как они будут работать.

- Apple Pencil 3 может иметь магнитные наконечники для различных стил...

- Apple начинает продавать восстановленную модель HomePod 2023 года в...

Возникновение генеративного ИИ

Новая волна инструментов ИИ покорила мир и дала нам видение нового способа работы и поиска информации, которая может оптимизировать нашу работу и нашу жизнь. Мы покажем вам, как инструменты, такие как ChatGPT и другое программное обеспечение генеративного ИИ, оказывают влияние на мир, как использовать их мощь, а также потенциальные риски.

Выводя параграф, изображение или даже скелет компьютерной программы, такие программы отражают творения общества.

Аспект отражения будет увеличиваться весьма быстрыми темпами.

Сегодняшние генеративные программы будут казаться примитивными по сравнению с возможностями программ, которые будут распространены к концу этого года, так как они будут выводить еще больше разных вещей.

Переход к нескольким модальностям

То, что компьютерные ученые называют смешанными модальностями или “мульти-модальностью”, станет центральным, поскольку программы объединяют текст, изображения, “облака точек” физического пространства, звуки, видео и целые компьютерные функции как интеллектуальные приложения.

Смешанная модальность позволит создавать намного более способные программы и способствует долгосрочной цели непрерывного обучения. Она даже может содействовать достижению цели “воплощенного ИИ” путем поддержки робототехники.

“ChatGPT был создан для развлечения, и он делает многое очень хорошо, но он, скажем так, является демо”, – сказал Навин Рао, основатель стартапа MosaicML, в интервью ENBLE. “Теперь нам нужно начать думать о том, как сделать его лучше, если я использую его для определенной цели?”

Рао, чья компания была приобретена Databricks за ее экспертизу в запуске программ ИИ, теперь занимает должность вице-президента по генеративному ИИ в Databricks.

Также: Искусственный интеллект Meta генерирует изображения и утверждает, что язык может быть все, что вам нужно

Частью этого улучшения будет сделать генеративный ИИ более чем просто личным “соучастником”, как GitHub Copilot от Microsoft, который помогает одному человеку при вводе в чат. Вместо этого программы станут коллаборативными для команд, – сказал Эмад Мостак, основатель и генеральный директор Stability.ai в интервью ENBLE.

“Много ИИ просто используется в режиме один-на-один или в виде автономного агента”, – сказал Мостак. “Сейчас это находится на уровне iPhone 2G, где есть только один режим и можно копировать и вставлять, в то время как, на мой взгляд, наиболее захватывающая возможность заключается в том, как мы можем лучше сотрудничать и рассказывать лучшие истории с его помощью, и это не одиночное предприятие”.

Одной из вещей, которая, как сказал Рао из Databricks, “фундаментально отсутствует”, является “многомодальность мира”, поскольку “большие языковые модели очень одномерны, они видят мир только через текст”.

Модальности относятся к характеру ввода и вывода, таким как текст, изображение или видео. Возможны исследования различных модальностей, так как те же базовые концепции, которые приводят к работе ChatGPT, могут быть применены к любому типу ввода.

“Многомодальность – это то, что, безусловно, необходимо”, – сказал Мостак. “Вам понадобятся модели каждого типа, и, возможно, если их объединить, это будет потрясающе”.

“Языковые штуки получили много внимания и восторга, поэтому СМИ сосредотачиваются на них, но люди серьезно работают над другими вещами”, – сказал Джим Келлер, известный дизайнер компьютерных чипов, который является генеральным директором стартапа по разработке ИИ-чипов Tenstorrent, в интервью с ENBLE. Келлер ставит на то, что работа с смешанными модальностями станет одним из важных требований ИИ в будущем.

Машина для любого типа данных

В большой языковой модели, которая является основой технологии ChatGPT, текст превращается в токен – квантифицированное математическое представление. Затем машина должна найти то, что отсутствует в либо замаскированных частях целой фразы, либо в конечной части фразы. Именно акт воссоздания приводит к созданию абзацев, которые выводит ChatGPT.

Точно так же, в случае изображений, широко используемый процесс диффузии – популяризированный версией Stable Diffusion от Stability.ai – портит изображения шумом, и акт воссоздания исходного изображения обучает нейронную сеть генерировать изображения высокой четкости.

Также: может ли генеративный ИИ решить нерешенные проблемы компьютерных наук?

Те же процессы восстановления отсутствующих или поврежденных данных быстро распространяются на множество модальностей или типов данных. Например, в недавнем выпуске журнала Nature биолог Дэвид Бейкер из Университета Вашингтона и его команда повредили последовательности аминокислот белков с помощью процесса, который они называют RFdiffusion. Этот процесс обучит нейронную сеть создавать белок, в симуляции, новый синтетический белок с желаемыми свойствами.

Такая синтезированная структура может значительно сократить количество необходимых для изобретения и тестирования новых антител для болезней белков. (Статья в журнале Nature находится за платной стеной, но бесплатная версия опубликована на файловом сервере bioRxiv. Дополнительную информацию можно найти на веб-сайте лаборатории Бейкера.)

Процесс RFdiffusion, разработанный лабораторией Бейкера из Института дизайна белков при Университете Вашингтона, повреждает последовательности аминокислот, чтобы затем создавать новую структуру белка, подобно созданию изображений с помощью диффузии.

“У нас есть лаборатории для каждой модальности”, – сказал Мостак из Stability.ai, утверждающий, что его компания и OpenAI являются “единственными двумя независимыми многомодальными компаниями”, вне технологических гигантов, таких как Google. Эта многомодальность включает в себя лабораторию в Stability.ai только для звука, лабораторию только для генерации кода, а также лабораторию для биологии, которая работает над вещами, такими как воссоздание изображений fMRI с использованием технологии Stable Diffusion.

Однако волшебство происходит, когда комбинируются более чем одна модальность. “Прорыв”, – сказал Мостак, пришел в работе, проведенной в прошлом году Кэтрин Кроусон и несколькими другими исследователями, которые обучили нейронную сеть генерировать изображения, улучшая их до уровня, соответствующего текстовому запросу. Они обнаружили, что переработка изображений в соответствии с “семантическим” содержанием текста улучшает качество изображения. Кроусон теперь работает в компании Stability.ai, отметил Мостак.

Эта работа с изображениями и текстом активно продвигается во многих учреждениях. Исследователи по ИИ в Meta предложили комбинацию текстовых и имиджевых машин, называемую CM3Leon, которая отличается не только выводом текста или изображений, но и выполнением задач, связанных с обоими одновременно, таких как идентификация объектов на данном изображении или создание подписей к данному изображению.

Нейронная сеть CM3Leon компании Meta смешивает изображения и текст для выполнения нескольких задач, таких как подробное описание данного изображения или точное изменение данного изображения. Подробности описаны в статье 2023 года “Масштабирование авторегрессивных многомодальных моделей: предварительное обучение и настройка инструкций” Лилу Ю и коллег из Meta AI.

Более полное представление о мире

Сочетание нескольких модальностей начинает создавать более полное представление о мире для нейронной сети. Рао из Databricks ссылается на нейробиологическую концепцию “стереогноза”, что означает знание мира через осязание. Если кто-то спрашивает, сколько мелочи у вас в кармане, вы можете почувствовать монеты и определить их размер и вес, не видя их. “У меня есть представление о мире и объектах, которые фактически представлены в нескольких модальностях”, – сказал он. “Если я могу учиться понятиям, охватывающим несколько модальностей, то мы сделали что-то интересное”.

Идея того, что разные ощущения расширяют понимание, находит отклик в проводимых мультимодальных экспериментах. Ведутся исследования по созданию так называемых “основных” нейронных сетей, способных смешивать огромное количество модальностей, и они демонстрируют любопытные преимущества в производительности.

Ученые из университета Карнеги-Меллон недавно предложили то, что они называют “высокомодальным мультимодальным трансформатором”, который объединяет не только текст, изображение, видео и речь, но также информацию из баз данных и временные ряды данных. Главный автор Пол Лианг и его коллеги отмечают, что они обнаружили “важное масштабирование” 10-модальной нейронной сети. “Производительность продолжает улучшаться с добавлением каждой модальности и переносится на совершенно новые модальности и задачи”.

Статья 2023 года “Высокомодальный мультимодальный трансформатор” Карнеги-Меллонского университета, написанная Полом Лиангом и его коллегами, объединяет не только текст, изображение, видео и речь, но также информацию из баз данных и временные ряды данных.

Ученые, в том числе Йиюань Чжан и его коллеги из Мультимедийной лаборатории Китайского университета Гонконга, увеличили количество модальностей до дюжины в своем Meta-Transformer. Его точечные облака моделируют трехмерное зрение, а данные гиперспектрального восприятия представляют электромагнитную энергию, отраженную от земли на снимках ландшафтов.

Meta-Transformer – это будущее генеративного искусственного интеллекта, с большим количеством данных разного рода, сливающихся для получения более полного представления о том, что производится в качестве выхода. Это исследуется в статье 2023 года “Meta-Transformer: единая рамка для мультимодального обучения” Йиюань Чжана и его коллег из Мультимедийной лаборатории Китайского университета Гонконга и OpenGVLab в Шанхайской лаборатории искусственного интеллекта.

Создание книжки из нескольких модальностей

Немедленная отдача от мультимодальности будет просто заключаться в том, чтобы обогатить вывод таких вещей, как ChatGPT, способами, выходящими далеко за рамки “демо” режима. Детская книжка, книга с текстовыми отрывками, совмещенными с иллюстрациями, является одним из немедленных примеров. Сочетая языковые и образные атрибуты, можно более тонко контролировать виды изображений, создаваемых при процессе диффузии.

Как объясняют ученые из Google и главный автор Ван-Дуо Курт Ма из Викторианского университета Веллингтона в Новой Зеландии, процесс, известный как направленная диффузия, может перемещать кошку – или замок, или птицу – через различные сцены, создавая серию изображений, которые не только позволяют более тонкое управление, но и создают переходы, как в повествовании.

Техника, называемая направленной диффузией, может перемещать объект – кошку, замок, птицу – через различные сцены, создавая серию изображений, которые не только позволяют более тонкое управление, но и создают переходы, как в повествовании. Это подробно описано в статье 2023 года “Направленная диффузия: прямое управление размещением объектов через направляющее внимание” Ван-Дуо Курта Ма и его коллег из Викторианского университета Веллингтона и исследовательского центра Google.

Аналогично, Хеонхо Чжон из Сунгкюнкванского университета в Корее, вместе с учеными из Корейского института науки и технологии, предложил еще один вариант диффузии – скрытую диффузию, которую они подробно описали в недавней статье. Они утверждают, что она дает доступ к более подробным деталям изображения на низком уровне детализации.

Результатом является возможность создавать книжки, где персонаж перемещается через различные сценарии изображений, словно добавляя регуляторы к текстовому подсказке для выбора разных сценариев. Согласованность объекта на изображениях называется “Итеративным согласованным внедрением личности”.

Техника, называемая скрытой диффузией, расширяет создание изображений с помощью так называемого “внедрения личности”, чтобы создать движение персонажа через изображения книжки.

Как и в случае с синтезом белка в лаборатории Бейкера, применения смешанной модальности могут стать довольно необычными. Еще одна недавняя статья Чэнью Танга и его коллег из отдела инженерии Кембриджского университета предлагает создание “цифрового двойника”, компьютерной симуляции человеческого тела с воспроизведением всех органов и тканей, а также потоков крови и других параметров, путем объединения данных из нескольких медицинских инструментов в одном процессе стабильной диффузии.

“И оба датчика движения (такие как акселерометры, электромиографические датчики и т. д.) и биохимические датчики (для обнаружения биомаркеров, соответствующих заболеванию, таких как датчики слюны, датчики пота и т. д.) могут производить конкретные выходные данные для пациента”, авторы пишут. “Хотя эти выходные данные имеют отличительные особенности, они все соответствуют одной и той же болезни.”

“Цифровой двойник” человеческого тела может быть создан путем объединения данных из нескольких медицинских приборов в одном процессе, аналогичном стабильному распространению. Диаграмма представляет собой “пятиуровневую дорожную карту для цифрового двойника тела”, как показано в статье 2023 года “Цифровой двойник человеческого тела: мастер-план” Чэнью Тан и его коллег из Университета Кембриджа.

Специальные модальные мастера

Каким образом модальности объединяются будет так же важно, как и какие из них, сказал Мостаку из Stability.ai. “Последний момент будет составлять композиция, так как эти строительные блоки, которые мы создаем, помещаются в соответствующее программное обеспечение, сначала нацеленное на искусственный интеллект, которое переосмысливает все это создание, потребление и процессные потоки с помощью этих новых крутых инструментов”, – сказал он.

Хотя некоторые мощные модели, такие как PaLM LLM или GPT-4 от Google, могут быть вызваны, много смешанных модальностей произойдет как оркестрация компонентов, сказал он. “Как вы объединяете модели в действительно интересные способы и имеете много разных моделей, работающих вместе для достижения желаемых результатов и дополнения этого?”

Он сказал, что хотя PaLM и GPT-4 могут быть мощными, есть много доказательств того, что “многие специализированные модели могут превзойти” самые большие программы. В результате “у нас будет много специализированных моделей, я думаю, в различных модальностях”, – сказал он, процесс “де-конструирования” технологии в соответствующие роли, “а затем некоторые мультимодальные модели, которые могут делать все, и их вызывают в соответствующее время для соответствующих вещей”.

Робототехника – следующая граница ИИ

Смешение модальностей заслуживает внимания в области воплощенного ИИ – в форме робототехники.

Сергей Левин, доцент кафедры электротехники Университета Калифорнии в Беркли, рассказал ENBLE, что в отношении генеративного ИИ системы в робототехнике играют важную роль.

“Многомодальные вещи довольно интересны”, – добавил Левин, член исследовательского центра искусственного интеллекта Беркли Университета, который также работает с командами Google.

Он сказал, что многомодальная нейронная сеть уже способна обрабатывать изображения и текст и производить “команды высокого уровня для робота”. Код, который робототехник обычно пишет для инструкции роботу, может быть “полностью автоматизирован, по сути”, – сказал Левин.

“То, что нам нужно, это возможность быстро и легко командовать роботами делать что-то”, – сказал Левин. “Преодоление этого разрыва – это то, что модели языка будут делать отлично”.

Также: RT-2 DeepMind делает управление роботом вопросом разговора с ИИ

Левин помог организовать раннюю демонстрацию в Google, которая была недавно опубликована, называемая PaLM-E, которую исследователи Google называют “модель многомодального языка воплощения”. Робот способен следовать серии инструкций, таких как “принеси мне чипсы с рисом из ящика”, которые модель языка разбивает на атомарные инструкции, такие как “подойти к ящику”, “открыть ящик”, “взять зеленый пакет чипсов с рисом” и т. д.

Последующая работа под названием RT-2, выполненная подразделением DeepMind в Google, расширяет возможности PaLM-E, добавляя возможность генерации пространственных координат для робота. Левин называет эту работу “значительным прогрессом”.

Как и в случае с концепцией стереогноза, Левин утверждает, что увеличение модальностей может привести к более глубокой модели мира и тем самым приносить некоторые базовые способности рассуждения.

Также: RT-2 DeepMind делает управление роботом вопросом разговора с ИИ

Если большие языковые модели и модели диффузии могут интегрировать процесс “обработки предыдущих изображений и предсказания [текстовых] описаний, и обработки предыдущих описаний и предсказания изображений”, – сказал Левин, – “теперь они могут начать, так сказать, проникать глубже в терминах того, как они понимают мир”.

Примитивным примером знания о мире является робот-бармен, над которым работал Левин, который проверяет удостоверение личности людей. “Вы можете действительно сказать модели языка: напишите мне некоторый код для робота-бармена, и она генерирует некоторую логику для этого, и если кто-то заказывает стакан воды, это неалкогольный напиток”, и поэтому не требуется проверка удостоверения личности.

Нам понадобится гораздо больше памяти

Комбинация робототехники и многомодальности имеет более глубокие последствия, поскольку она значительно увеличивает потребность в данных. Сегодняшние генеративные искусственные интеллекты, такие как ChatGPT, не имеют явной памяти. Они работают только с последним набором текста, который вы ввели, и со временем забывают о прошлом.

Использование многомодальности, включающей гораздо больше примеров данных, заставит генеративные искусственные интеллекты развить что-то вроде реальной памяти данных. “Когда мы начинаем переходить к многомодельным моделям, это становится намного более требовательным к контексту”, – сказал Левин. “Ведь текущая прототипная модель принимает одно изображение, но, возможно, вы хотите показать ей тысячу изображений.

Возможно, вы хотите показать ей экскурсию по вашему дому, чтобы она знала, где находится каждый предмет в вашем доме, чтобы, когда вы попросите ее принести ключи от машины, она могла бы взглянуть на свою память и определить, где находятся ключи от машины – это требует намного более длительного контекста”.

Также: Microsoft, TikTok дают генеративному искусственному интеллекту своего рода память

Видеоданные могут быть также, если не более важными для создания портрета мира роботом. Эти видео, в сочетании с текстом, облаками точек и другими модальностями, становятся симулятором, с помощью которого робот может построить модель мира, – сказал Левин. “Если эти модели в сущности предоставляют возможность создавать симуляторы очень высокой точности, это может иметь значительное влияние в будущем”.

Расширение до тысяч изображений и, возможно, часов видео, а также гигабайтов точечных облаков и 3D-данных для обучения многомодальных программ означает, что ChatGPT и другие должны значительно расширить свой доступ к данным с помощью так называемого банка памяти.

Множество усилий направлено на “расширение” языковых моделей с помощью так называемого извлечения из базы данных. Это можно увидеть в программе CM3Leon от Meta, которая позволяет программному обеспечению обратиться к базе данных и найти соответствующие изображения.

Такие усилия, как технология Hyena в Стэнфордском университете и институте MILA в Канаде, пытаются значительно расширить то, что можно подать на вход программы, чтобы вводить любое количество данных любой модальности.

Также: Эта новая технология может уничтожить GPT-4 и все подобное ему

Это означает, что вместе с многомодальностью преемники ChatGPT смогут управлять гораздо большим контекстом – целыми книгами, сериями статей, фильмами и записями физических структур в трех измерениях. Это также означает, что контекст для любой задачи может стать намного более индивидуальным или адаптированным к знаниям группы. Мостак сказал, что такие модели принесут не только обобщенные знания GPT-4, но и конкретные знания, а также знания вашей команды, вашей компании и т. д.

“Я думаю, это большой прорыв, когда они станут предоставлять услуги предприятиям в следующем году”, – сказал Мостак, отсылая к неминуемому популярному принятию генеративного искусственного интеллекта в корпоративных средах.

Система “Self-Controlled Memory” владельца TikTok, компании ByteDance, может обратиться к базе данных с сотнями диалогов и тысячами персонажей, чтобы предоставить любой языковой модели возможности превосходящие ChatGPT в ответах на вопросы о прошлых событиях. Это показано в статье 2023 года “Unleashing Infinite-Length Input Capacity for Large-scale Language Models with Self-Controlled Memory System” авторства Синьяна Лианга и коллег из ByteDance AI Lab.

Достижение непрерывного обучения

По мере расширения многомодальности до видео, аудио, облаков точек и всего остального, Келлер, генеральный директор компании Tenstorrent, считает, что более продвинутые генеративные модели, особенно те, которые поступают из сообщества программного обеспечения с открытым исходным кодом, приведут к глубокому изменению различия между обучением и выводом в области.

Обучение – это процесс первоначального разработки нейронной сети. Это крайне затратный научный процесс, в котором используется сотни или даже тысячи графических процессоров. Вывод – это использование готовой сети для предсказаний для конечных пользователей, гораздо менее требовательный процесс, широко развернутый как облачный сервис.

Но “генеративные модели на самом деле используют множество функций из обучения в выводе”, – сказал Келлер. Программа, такая как Stable Diffusion от Stability.ai для создания изображений, обновляет свою нейронную сеть во время вывода. “Она многопроходная: у нее есть обратный проход”, а также типичный прямой процесс предсказаний, так что “она выглядит, как будто находится в режиме обучения”.

По этой причине “Я думаю, что ИИ-движок будущего … будет обладать достаточно разнообразными наборами возможностей, которые не будут выглядеть как выводы или обучение, а больше похожи на их слияние.”

Если Келлер прав, будущие генеративные модели могут стать началом давно преследуемой цели непрерывного обучения для машинного обучения, также иногда называемого онлайн-обучением, при котором генеративная нейронная сеть не фиксирована после обучения, а постоянно развивается по мере того, как люди используют ее все больше. “Я думаю, что это будет так,” соглашается Мостаки из Stability.ai. “Непрерывное обучение будет ключевым, потому что то, как мы это делаем сейчас, то есть обучение модели одним и тем же несколько раз, не является адекватным.”

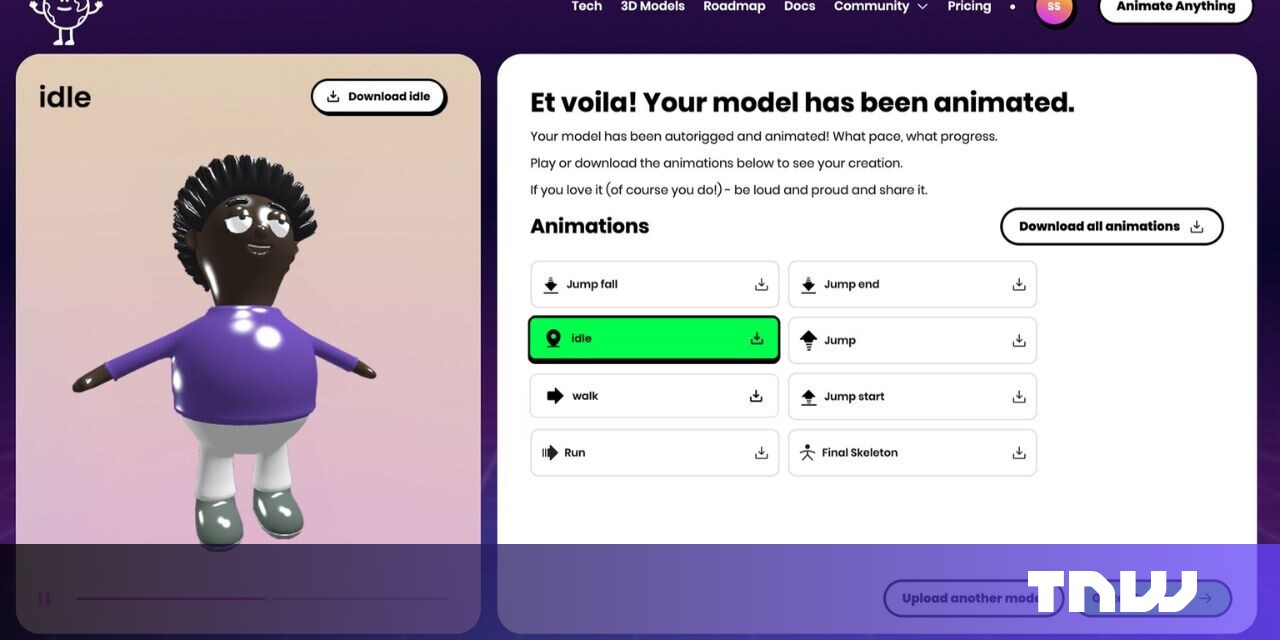

Как уже сказал Мостаки, такие вещи, как “Dream Booth” от Stability.ai, позволяют создавать персонализированную версию изображения, уже выходят за рамки жесткой идеи повторного обучения языковой-изображенческой модели и становятся более гибкими. Он говорит, что они становятся персональными аватарами, и в ближайшие несколько месяцев появится своего рода гипер-“Dream Booth”, который позволит персонализировать все ваши изображения в режиме реального времени. “Вот почему непрерывное обучение будет так важно: для обеспечения этого непрерывного процесса, чтобы он развивался.”